mirror of

https://www.modelscope.cn/ZhipuAI/GLM-4.1V-9B-Thinking.git

synced 2026-05-19 17:32:54 +08:00

1

This commit is contained in:

17

README.md

17

README.md

@ -4,17 +4,26 @@ license: mit

|

||||

|

||||

# GLM-4.1V-9B-Thinking

|

||||

|

||||

<div align="center">

|

||||

<img src=https://raw.githubusercontent.com/THUDM/GLM-4.1V-Thinking/99c5eb6563236f0ff43605d91d107544da9863b2/resources/logo.svg?token=AWHLTA2NQS4GTJIGAS3S72LIMQSFU width="40%"/>

|

||||

</div>

|

||||

<p align="center">

|

||||

💡 立即在线体验 <a href="https://huggingface.co/spaces/THUDM/GLM-4.1V-9B-Thinking-Demo" target="_blank">Hugging Face</a> 或 <a href="https://modelscope.cn/studios/ZhipuAI/GLM-4.1V-9B-Thinking-Demo" target="_blank">ModelScope</a> 上的 GLM-4.1V-9B-Thinking。

|

||||

<br>

|

||||

📍 在 <a href="https://www.bigmodel.cn/dev/api/visual-reasoning-model/GLM-4.1V-Thinking">智谱大模型开放平台</a> 使用 GLM-4.1V-9B-Thinking 的API服务。

|

||||

</p>

|

||||

|

||||

## 模型介绍

|

||||

|

||||

视觉语言大模型(VLM)已经成为智能系统的关键基石。随着真实世界的智能任务越来越复杂,VLM模型也亟需在基本的多模态感知之外,

|

||||

逐渐增强复杂任务中的推理能力,提升自身的准确性、全面性和智能化程度,使得复杂问题解决、长上下文理解、多模态智能体等智能任务成为可能。

|

||||

|

||||

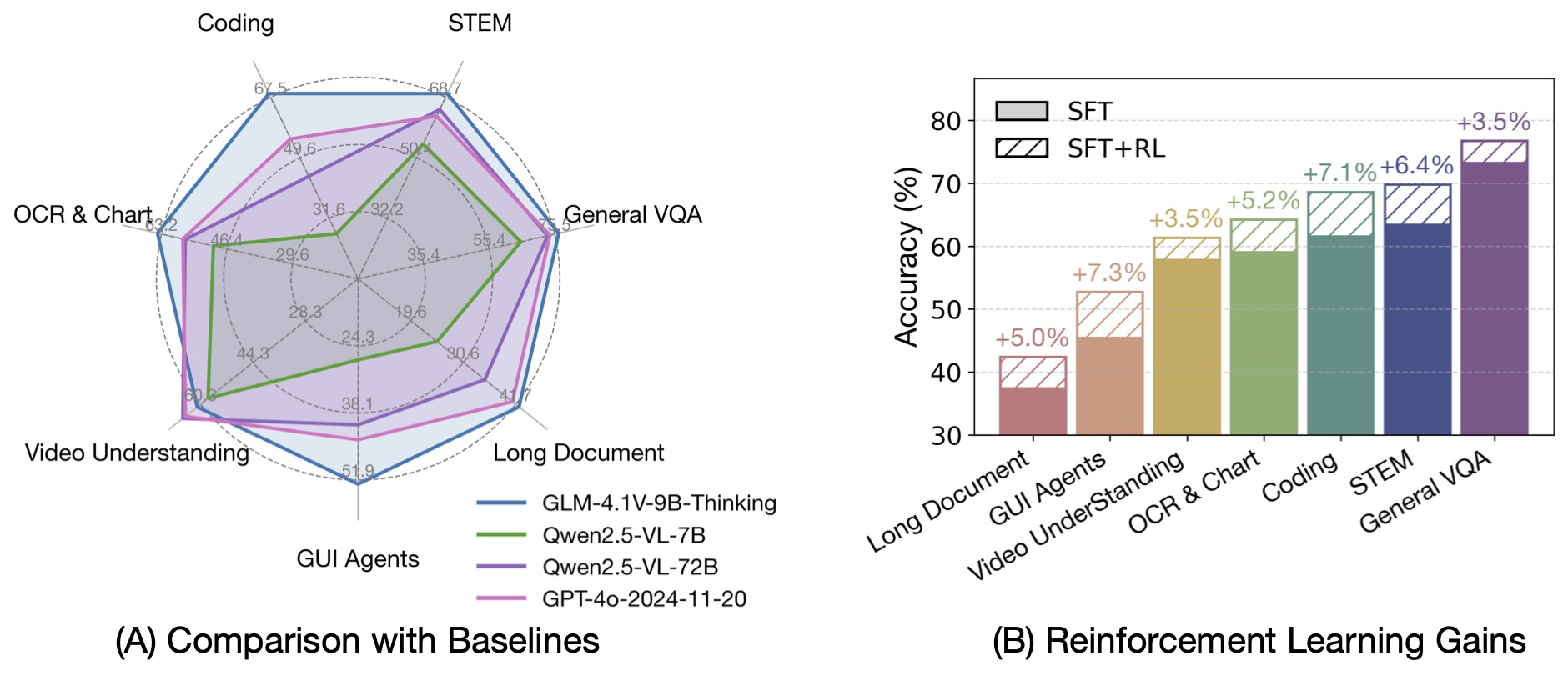

基于 [GLM-4-9B-0414](https://github.com/THUDM/GLM-4) 基座模型,我们推出新版VLM开源模型 **GLM-4.1V-9B-Thinking**

|

||||

,探索推理模型在视觉语言模型的多个领域中的上限。 引入思考范式,通过强化学习全面提升模型能力,

|

||||

达到10B参数级别的视觉语言模型的最强性能,在18个榜单任务中持平甚至超过8倍参数量的Qwen-2.5-VL-72B。

|

||||

我们同步开源基座模型 GLM-4.1V-9B-Base,希望能够帮助更多研究者探索视觉语言模型的能力边界。

|

||||

,引入思考范式,通过课程采样强化学习 RLCS(Reinforcement Learning with Curriculum Sampling)全面提升模型能力,

|

||||

达到 10B 参数级别的视觉语言模型的最强性能,在18个榜单任务中持平甚至超过8倍参数量的 Qwen-2.5-VL-72B。

|

||||

我们同步开源基座模型 **GLM-4.1V-9B-Base**,希望能够帮助更多研究者探索视觉语言模型的能力边界。

|

||||

|

||||

|

||||

|

||||

|

||||

与上一代的 CogVLM2 及 GLM-4V 系列模型相比,**GLM-4.1V-Thinking** 有如下改进:

|

||||

|

||||

|

||||

Reference in New Issue

Block a user