From 71e5c048992cd263ef8284990057d4c69a351c5a Mon Sep 17 00:00:00 2001

From: zRzRzRzRzRzRzR <2448370773@qq.com>

Date: Wed, 2 Jul 2025 02:10:37 +0800

Subject: [PATCH] 1

---

README.md | 17 +++++++++++++----

1 file changed, 13 insertions(+), 4 deletions(-)

diff --git a/README.md b/README.md

index 4d1f23b..8a476fd 100644

--- a/README.md

+++ b/README.md

@@ -4,17 +4,26 @@ license: mit

# GLM-4.1V-9B-Thinking

+

+

+

+ 💡 立即在线体验 Hugging Face 或 ModelScope 上的 GLM-4.1V-9B-Thinking。

+

+ 📍 在 智谱大模型开放平台 使用 GLM-4.1V-9B-Thinking 的API服务。

+

+

## 模型介绍

视觉语言大模型(VLM)已经成为智能系统的关键基石。随着真实世界的智能任务越来越复杂,VLM模型也亟需在基本的多模态感知之外,

逐渐增强复杂任务中的推理能力,提升自身的准确性、全面性和智能化程度,使得复杂问题解决、长上下文理解、多模态智能体等智能任务成为可能。

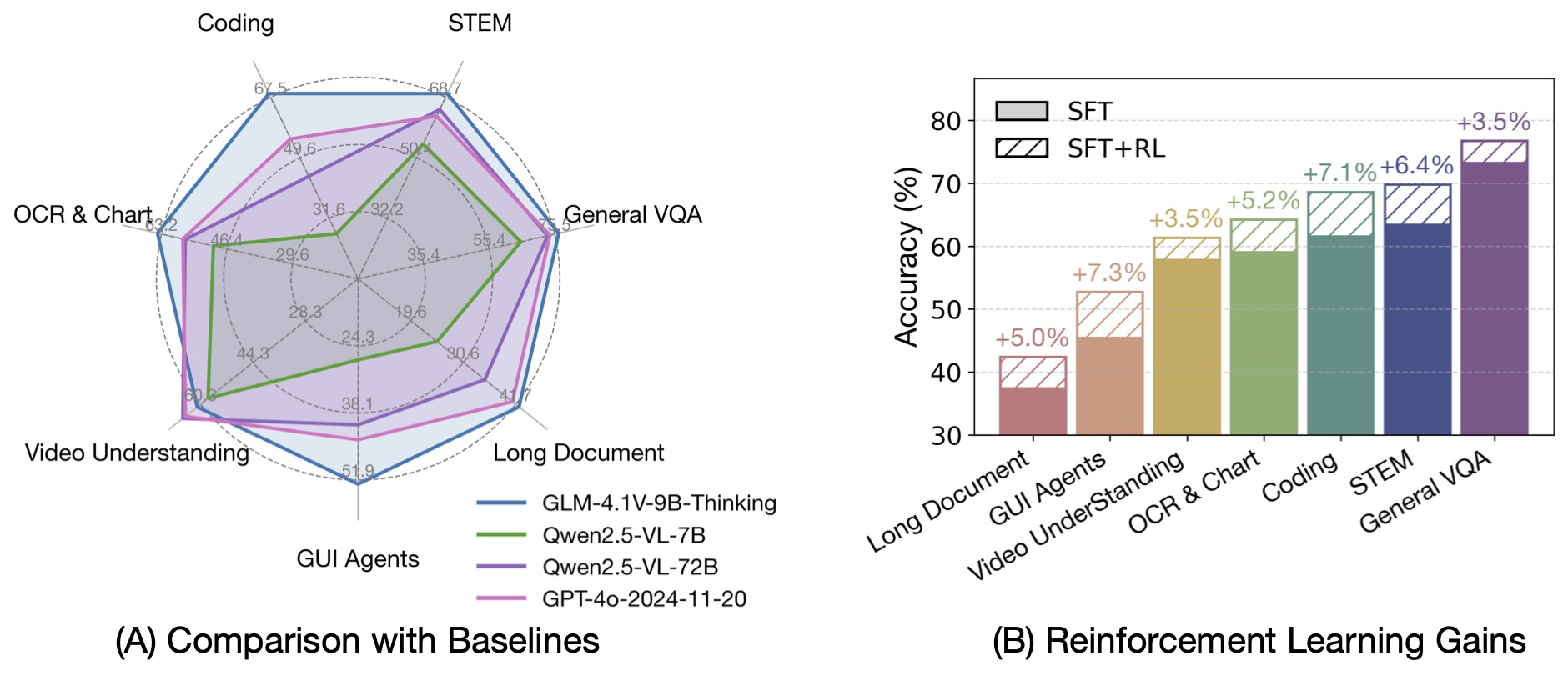

基于 [GLM-4-9B-0414](https://github.com/THUDM/GLM-4) 基座模型,我们推出新版VLM开源模型 **GLM-4.1V-9B-Thinking**

-,探索推理模型在视觉语言模型的多个领域中的上限。 引入思考范式,通过强化学习全面提升模型能力,

-达到10B参数级别的视觉语言模型的最强性能,在18个榜单任务中持平甚至超过8倍参数量的Qwen-2.5-VL-72B。

-我们同步开源基座模型 GLM-4.1V-9B-Base,希望能够帮助更多研究者探索视觉语言模型的能力边界。

+,引入思考范式,通过课程采样强化学习 RLCS(Reinforcement Learning with Curriculum Sampling)全面提升模型能力,

+达到 10B 参数级别的视觉语言模型的最强性能,在18个榜单任务中持平甚至超过8倍参数量的 Qwen-2.5-VL-72B。

+我们同步开源基座模型 **GLM-4.1V-9B-Base**,希望能够帮助更多研究者探索视觉语言模型的能力边界。

-

+

与上一代的 CogVLM2 及 GLM-4V 系列模型相比,**GLM-4.1V-Thinking** 有如下改进: