4.7 KiB

Index-1.9B-32K

模型简介

Index-1.9B-32K 是一个仅有 1.9B 参数、却具备 32K 上下文长度的语言模型(这意味着,这个超小精灵可以一次性读完 3.5 万字以上的文档)。该模型专门针对 32K 以上的长文本进行了持续预训练(Continue Pre-Train)和监督微调(SFT),主要基于我们精心清洗的长文本预训练语料、自建的长文本指令集进行训练。目前,我们已在 Hugging Face 和 ModelScope 上同步开源。

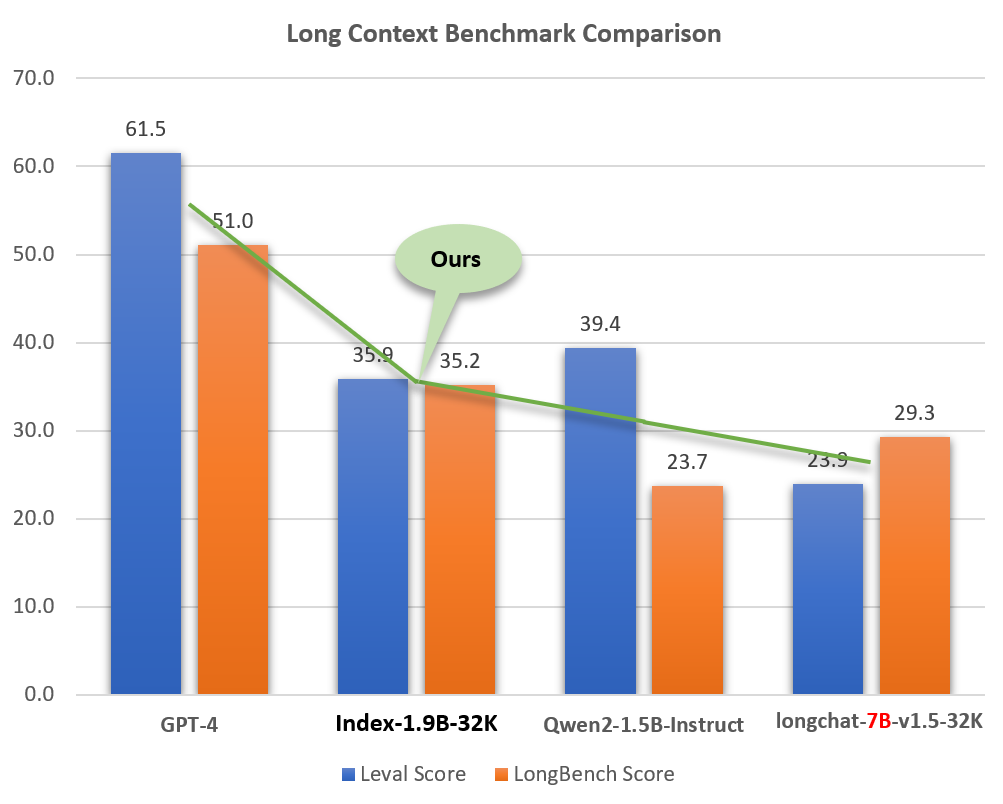

Index-1.9B-32K 以极小的模型体积(约为 GPT-4 等模型的 2%),实现了出色的长文本处理能力。如下图,我们1.9B尺寸的模型分数甚至远超7B尺寸的模型。以下为与 GPT-4、Qwen2等模型的对比:

Index-1.9B-32K与GPT-4、Qwen2等模型长文本能力对比

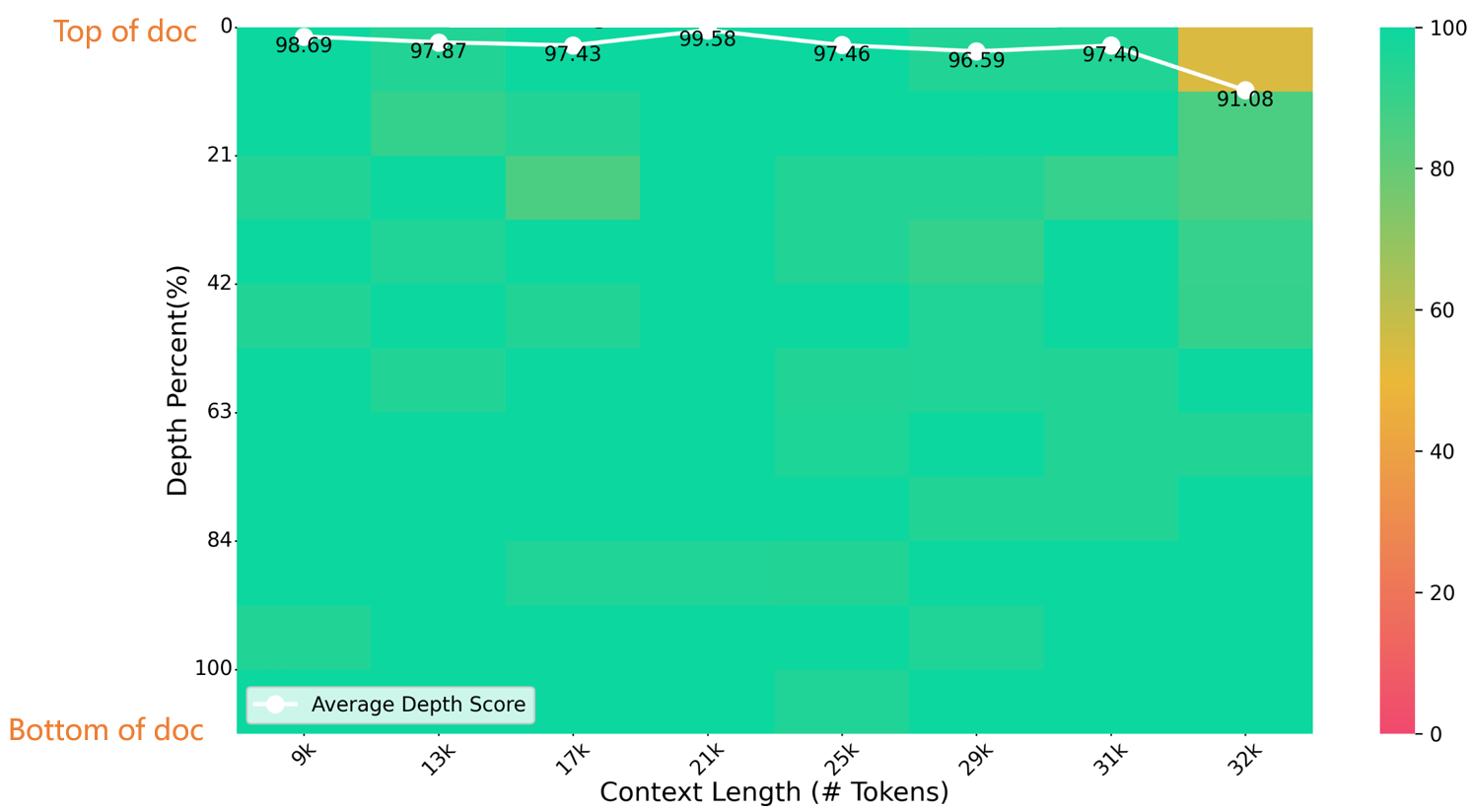

Index-1.9B-32K在32K长度的大海捞针测试下,评测结果优异,如下图,评测结果只在(32K 长度,%10 深度)区域有一处黄斑(91.08分),其他范围表现优异,几乎全绿。

Index-1.9B-32K模型下载、使用、技术报告:

Index-1.9B-32K模型下载、使用方法、技术报告详见:

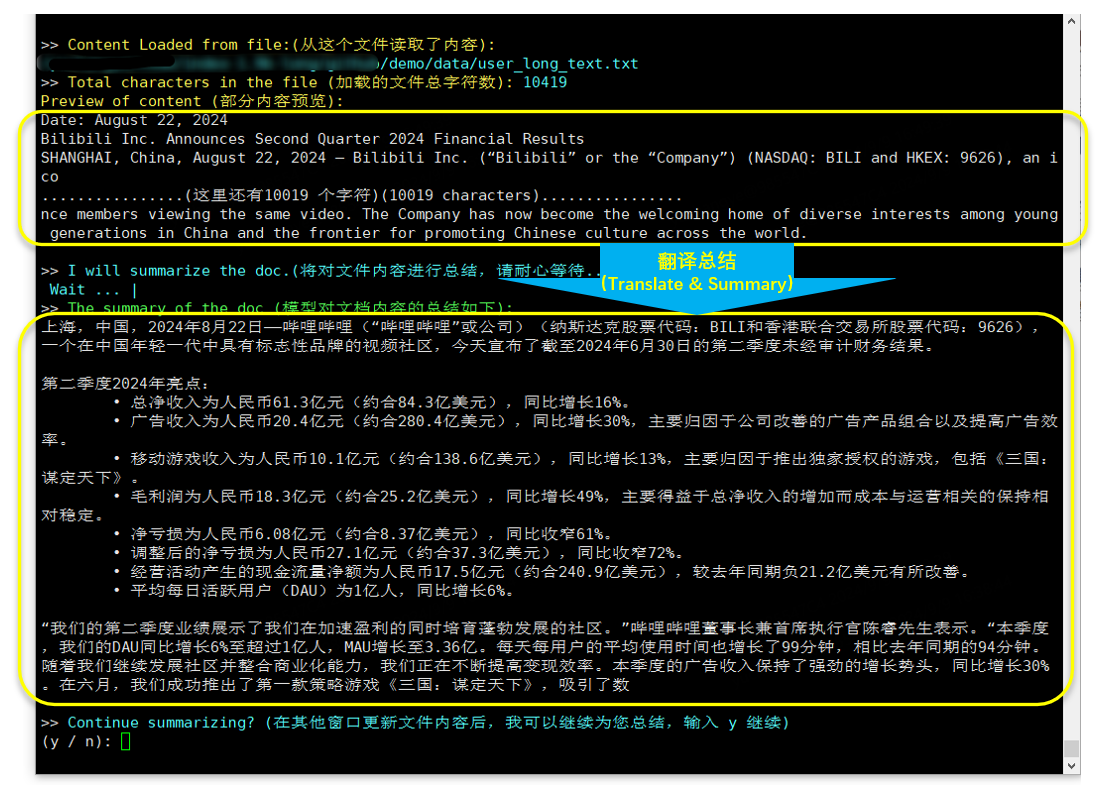

使用:长文本翻译&总结(Index-1.9B-32K)

- 下载仓库:

git clone https://github.com/bilibili/Index-1.9B

cd Index-1.9B

-

下载模型到本地.

-

使用 pip 安装依赖:

pip install -r requirements.txt

- 运行长文本专用的交互工具:demo/cli_long_text_demo.py

- 模型默认会读取该文件:data/user_long_text.txt,将对文本内容进行中文总结。

- 可以新建一个窗口,实时修改文件内容,模型会读取最新的文件内容并总结。

cd demo/

CUDA_VISIBLE_DEVICES=0 python cli_long_text_demo.py --model_path '/path/to/model/' --input_file_path data/user_long_text.txt

- 运行&交互效果(翻译并总结哔哩哔哩公司于2024.8.22发布的英文财报 --- 英文财报原文在这里):

局限性与免责申明

Index-1.9B-32K在某些情况下可能会产生不准确、有偏见或其他令人反感的内容。模型生成内容时无法理解、表达个人观点或价值判断,其输出内容不代表模型开发者的观点和立场。因此,请谨慎使用模型生成的内容,用户在使用时应自行负责对其进行评估和验证,请勿将生成的有害内容进行传播,且在部署任何相关应用之前,开发人员应根据具体应用对模型进行安全测试和调优。

我们强烈警告不要将这些模型用于制造或传播有害信息,或进行任何可能损害公众、国家、社会安全或违反法规的活动,也不要将其用于未经适当安全审查和备案的互联网服务。我们已尽所能确保模型训练数据的合规性,但由于模型和数据的复杂性,仍可能存在无法预见的问题。如果因使用这些模型而产生任何问题,无论是数据安全问题、公共舆论风险,还是因模型被误解、滥用、传播或不合规使用所引发的任何风险和问题,我们将不承担任何责任。

模型开源协议

使用本仓库的源码需要遵循 [Apache-2.0]{.underline} 开源协议,使用 Index-1.9B-32K的模型权重则需要遵循[模型许可协议]{.underline}。

Index-1.9B-32K模型权重对学术研究完全开放,并且支持免费商用。

引用

如果你觉得我们的工作对你有帮助,欢迎引用!

@article{Index-1.9B-32K,

title={Index-1.9B-32K Long Context Technical Report},

year={2024},

url={https://github.com/bilibili/Index-1.9B/blob/main/Index-1.9B-32K_Long_Context_Technical_Report.md},

author={Changye Yu, Tianjiao Li, Lusheng Zhang and IndexTeam}

}