47 KiB

HunyuanVideo-1.5

HunyuanVideo-1.5作为一款轻量级视频生成模型,仅需83亿参数即可提供顶级画质,大幅降低使用门槛。该模型在消费级显卡上运行流畅,让每位开发者和创作者都能轻松使用。本代码库提供生成创意视频所需的实现方案与工具集。

👏 加入我们的 微信社区 和 Discord | 💻 官方网站 立即体验模型!

🔥🔥🔥 最新动态

- 🚀 Nov 24, 2025: 我们现已支持 cache 推理,可实现约两倍加速!请 pull 最新代码体验。 🔥🔥🔥🆕

- 👋 Nov 20, 2025: 我们开源了 HunyuanVideo-1.5的代码和推理权重

🎥 演示视频

🧩 社区贡献

如果您在项目中使用或开发了 HunyuanVideo-1.5,欢迎告知我们。

-

ComfyUI - ComfyUI: 一个强大且模块化的扩散模型图形界面,采用节点式工作流。ComfyUI 支持 HunyuanVideo-1.5,并提供多种工程加速优化以实现快速推理。 我们提供了一个 ComfyUI 使用指南 用于 HunyuanVideo-1.5。

-

社区实现的 ComfyUI 插件 - comfyui_hunyuanvideo_1.5_plugin: 社区实现的 HunyuanVideo-1.5 ComfyUI 插件,提供简化版和完整版节点集,支持快速使用或深度工作流定制,内置自动模型下载功能。

-

LightX2V - LightX2V: 一个轻量级高效的视频生成框架,集成了 HunyuanVideo-1.5,支持多种工程加速技术以实现快速推理。

-

Wan2GP v9.62 - Wan2GP: Wan2GP 是一款对显存要求非常低的应用(在 Hunyuan Video 1.5 下最低仅需 6GB 显存),支持 Lora 加速器实现 8 步生成,并且提供多种视频生成辅助工具。

📑 开源计划

- HunyuanVideo-1.5 (文生视频/图生视频)

- 推理代码和模型权重

- 支持 ComfyUI

- 支持 LightX2V

- Diffusers 支持

- 发布所有模型权重(稀疏注意力、蒸馏模型和超分辨率模型)

📋 目录

- 🔥🔥🔥 最新动态

- 🎥 演示视频

- 🧩 社区贡献

- 📑 开源计划

- 📖 模型介绍

- ✨ 核心特性

- 📜 系统要求

- 🛠️ 依赖安装

- 🧱 下载预训练模型

- 📝 提示词指南

- 🔑 使用方法

- 🧱 模型卡片

- 🎬 更多示例

- 📊 性能评估

- 📚 引用

- 🙏 致谢

- 🌟 GitHub Star 历史

📖 Introduction

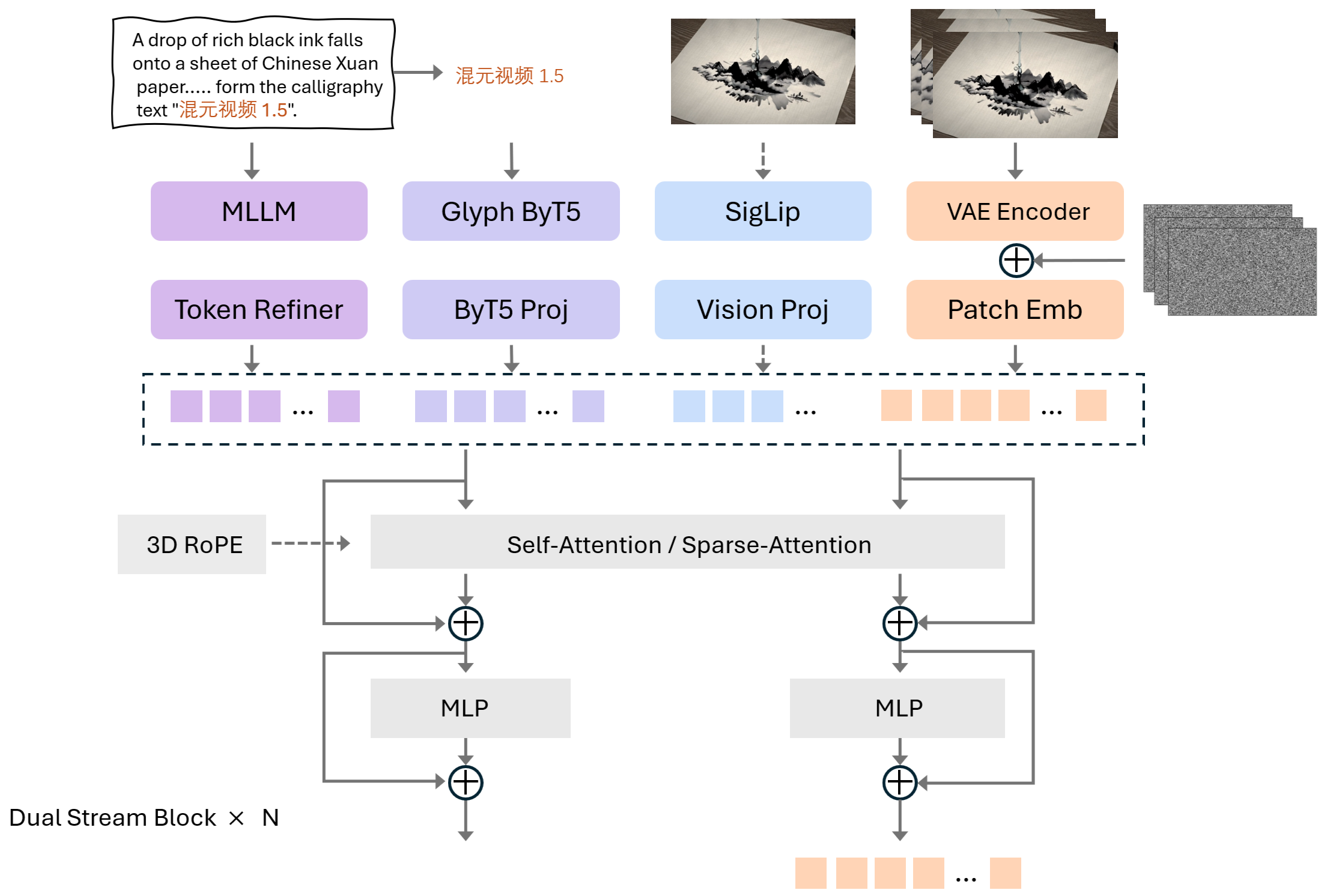

我们推出了 HunyuanVideo-1.5,一个轻量级但功能强大的视频生成模型。该模型仅使用8.3B参数就实现了开源最先进的视觉质量和运动连贯性,并能在消费级 GPU 上进行高效推理。这一成果基于几个关键组件,包括精细的数据整理、采用稀疏注意力SSTA的DiT 架构、通过专用 OCR 编码增强的双语理解能力、渐进式预训练和后训练,以及高效的视频超分辨率网络。利用这些设计,我们开发了一个统一的框架,能够跨多种时长和分辨率生成高质量的文生视频和图生视频。大量实验证明,这个紧凑而高效的模型在开源模型中确立了新的技术标杆。通过发布 HunyuanVideo-1.5 的代码和权重,我们为社区提供了一个高性能的基础,显著降低了视频创作和研究的成本,使先进的视频生成技术对所有人更加触手可及。

✨ Key Features

- 轻量级高性能架构:我们提出了一种高效架构,将 83 亿参数的 Diffusion Transformer(DiT)与 3D 因果 VAE 相结合,在空间维度实现了 16 倍的压缩,在时间轴上实现了 4 倍的压缩。此外,创新的 SSTA机制修剪了冗余的时空 kv 块,显著减少了长视频序列的计算开销,并加速了推理,在 10 秒 720p 视频合成中,相比 FlashAttention-3 实现了端到端

1.87 \times的加速。

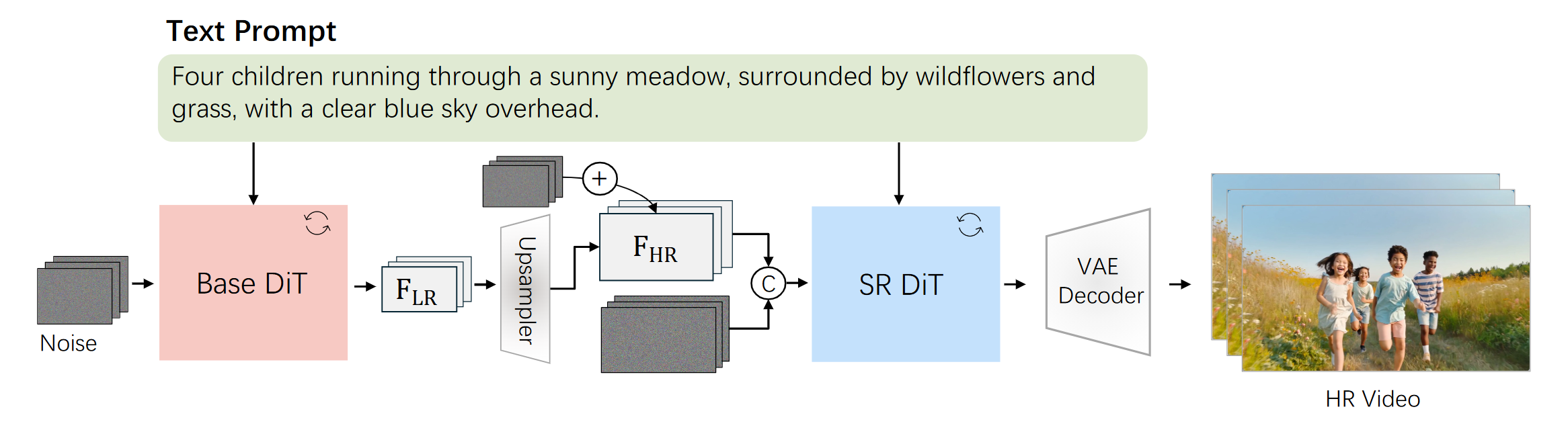

- 视频超分辨率增强:我们开发了一个高效的少步数超分辨率网络,可将输出上采样至 1080p。它在增强锐度的同时校正失真,从而优化细节和整体视觉纹理。

- 端到端训练优化:本工作采用了多阶段、渐进式的训练策略,覆盖了从预训练到后训练的整个流程。结合 Muon 优化器加速收敛,这种方法整体上优化了运动连贯性、美学质量和对人类偏好的对齐,实现了专业级的内容生成。

📜系统要求

硬件要求

-

GPU:支持 CUDA 的 NVIDIA GPU

-

最低 GPU 显存:14 GB(启用模型卸载时)

注意: 上述内存要求是在启用模型卸载的情况下测量的。如果您的 GPU 有足够的显存,可以禁用卸载以提高推理速度。

软件要求

- 操作系统:Linux

- Python:Python 3.10 或更高版本

- CUDA:与您的 PyTorch 安装兼容的 CUDA 版本

🛠️ 依赖安装

步骤 1:克隆仓库

git clone https://github.com/Tencent-Hunyuan/HunyuanVideo-1.5.git

cd HunyuanVideo-1.5

步骤 2:安装基础依赖

pip install -r requirements.txt

pip install -i https://mirrors.tencent.com/pypi/simple/ --upgrade tencentcloud-sdk-python

步骤 3:安装注意力库

-

Flash Attention: 安装 Flash Attention 以实现更快的推理速度和更低的 GPU 内存消耗。 详细安装说明请参考 Flash Attention。

-

Flex-Block-Attention: flex-block-attn 仅在使用稀疏注意力以实现更快推理时需要,可以通过以下命令安装:

git clone https://github.com/Tencent-Hunyuan/flex-block-attn.git cd flex-block-attn git submodule update --init --recursive python3 setup.py install -

SageAttention: 要启用 SageAttention 以实现更快的推理,您需要通过以下命令安装:

注意: 启用 SageAttention 将自动禁用 Flex-Block-Attention。

git clone https://github.com/cooper1637/SageAttention.git cd SageAttention export EXT_PARALLEL=4 NVCC_APPEND_FLAGS="--threads 8" MAX_JOBS=32 # Optional python3 setup.py install

🧱 下载预训练模型

💡 蒸馏模型和稀疏注意力模型即将发布,敬请期待。请关注 Hugging Face 模型卡片获取最新更新。

在生成视频之前,请先下载预训练模型。详细说明请参考 checkpoints-download.md。

📝 提示词指南

提示词撰写手册

提示词增强在我们的模型生成高质量视频方面起着至关重要的作用。通过撰写更长、更详细的提示词,生成的视频质量将得到显著改善。我们鼓励您编写全面且描述性的提示词,以获得最佳的视频质量。我们建议社区伙伴参考我们的官方指南,了解如何撰写有效的提示词。

自动提示词增强的系统提示词

对于希望为其他大模型优化提示词的用户,建议参考文件 hyvideo/utils/rewrite/t2v_prompt.py 中 t2v_rewrite_system_prompt 的定义来指导文生视频的提示词重写。同样,对于图生视频重写,请参考 hyvideo/utils/rewrite/i2v_prompt.py 中 i2v_rewrite_system_prompt 的定义。

🔑 使用方法

视频生成

对于提示词重写,我们推荐使用 Gemini 或通过 vLLM 部署的大模型。当前代码库仅支持兼容 vLLM 接口的模型,如果您希望使用 Gemini,需自行实现相关接口调用。

对于 vLLM 接口的模型,需要注意 T2V 和 I2V 推荐使用不同的模型和环境变量:

- 文生视频(T2V):推荐使用 Qwen3-235B-A22B-Thinking-2507,并配置

T2V_REWRITE_BASE_URL与T2V_REWRITE_MODEL_NAME - 图生视频(I2V):推荐使用 Qwen3-VL-235B-A22B-Instruct,并配置

I2V_REWRITE_BASE_URL与I2V_REWRITE_MODEL_NAME

你也可以将上述模型名替换为任何你已部署、与 vLLM 兼容的模型(包括 HuggingFace 等模型)。

默认为开启提示词重写(

--rewrite默认值为true)。若需显式关闭,可以使用--rewrite false或--rewrite 0。如果未配置 vLLM 提示词重写相关服务,管道会在本地直接生成,无远程重写。

示例:生成视频(支持 T2V/I2V。T2V 模式下设置 IMAGE_PATH=none,I2V 模式下指定图像路径)

export T2V_REWRITE_BASE_URL="<your_vllm_server_base_url>"

export T2V_REWRITE_MODEL_NAME="<your_model_name>"

export I2V_REWRITE_BASE_URL="<your_vllm_server_base_url>"

export I2V_REWRITE_MODEL_NAME="<your_model_name>"

PROMPT='A girl holding a paper with words "Hello, world!"'

IMAGE_PATH=./data/reference_image.png # 可选,'none' 或 <图像路径>

SEED=1

ASPECT_RATIO=16:9

RESOLUTION=480p

OUTPUT_PATH=./outputs/output.mp4

# 配置

N_INFERENCE_GPU=8 # 并行推理 GPU 数量

CFG_DISTILLED=true # 使用 CFG 蒸馏模型进行推理,2倍加速

SPARSE_ATTN=false # 使用稀疏注意力进行推理(仅 720p 模型配备了稀疏注意力)。请确保 flex-block-attn 已安装

SAGE_ATTN=true # 使用 SageAttention 进行推理

REWRITE=true # 启用提示词重写。请确保 rewrite vLLM server 已部署和配置。

OVERLAP_GROUP_OFFLOADING=true # 仅在组卸载启用时有效,会显著增加 CPU 内存占用,但能够提速

ENABLE_CACHE=true # 启用特征缓存进行推理。显著提升推理速度

MODEL_PATH=ckpts # 预训练模型路径

torchrun --nproc_per_node=$N_INFERENCE_GPU generate.py \

--prompt "$PROMPT" \

--image_path $IMAGE_PATH \

--resolution $RESOLUTION \

--aspect_ratio $ASPECT_RATIO \

--seed $SEED \

--cfg_distilled $CFG_DISTILLED \

--sparse_attn $SPARSE_ATTN \

--use_sageattn $SAGE_ATTN \

--enable_cache $ENABLE_CACHE \

--rewrite $REWRITE \

--output_path $OUTPUT_PATH \

--overlap_group_offloading $OVERLAP_GROUP_OFFLOADING \

--save_pre_sr_video \

--model_path $MODEL_PATH

Tips: 如果您的 GPU 内存 > 14GB 但您在生成过程中遇到 OOM (Out of Memory) 错误,可以尝试在运行前设置以下环境变量:

export PYTORCH_CUDA_ALLOC_CONF=expandable_segments:True,max_split_size_mb:128Tips: 如果您有 CPU 内存有限并且遇到推理时的 OOM 错误,可以尝试禁用重叠组卸载,通过添加以下参数:

--overlap_group_offloading false

命令行参数

| 参数 | 类型 | 是否必需 | 默认值 | 描述 |

|---|---|---|---|---|

--prompt |

str | 是 | - | 用于视频生成的文本提示 |

--negative_prompt |

str | 否 | '' |

用于视频生成的负向提示词 |

--resolution |

str | 是 | - | 视频分辨率:480p 或 720p |

--model_path |

str | 是 | - | 预训练模型目录的路径 |

--aspect_ratio |

str | 否 | 16:9 |

输出视频的宽高比 |

--num_inference_steps |

int | 否 | 50 |

推理步数 |

--video_length |

int | 否 | 121 |

要生成的帧数 |

--seed |

int | 否 | 123 |

随机种子,用于可复现性 |

--image_path |

str | 否 | None |

参考图像的路径(启用图生视频模式)。使用 none 或 None 可明确使用文生视频模式 |

--output_path |

str | 否 | None |

输出文件路径(如果未提供,则保存到 ./outputs/output_{transformer_version}_{timestamp}.mp4) |

--sr |

bool | 否 | true |

启用超分辨率(使用 --sr false 或 --sr 0 来禁用) |

--save_pre_sr_video |

bool | 否 | false |

保存超分辨率处理前的原始视频(使用 --save_pre_sr_video 或 --save_pre_sr_video true 来启用,仅在启用超分辨率时有效) |

--rewrite |

bool | 否 | true |

启用提示词重写(使用 --rewrite false 或 --rewrite 0 来禁用,禁用可能导致视频生成质量降低) |

--cfg_distilled |

bool | 否 | false |

启用 CFG 蒸馏模型以加速推理(约 2 倍加速,使用 --cfg_distilled 或 --cfg_distilled true 来启用) |

--sparse_attn |

bool | 否 | false |

启用稀疏注意力以加速推理(约 1.5-2 倍加速,需要 H 系列 GPU,会自动启用 CFG 蒸馏,使用 --sparse_attn 或 --sparse_attn true 来启用) |

--offloading |

bool | 否 | true |

启用 CPU 卸载(使用 --offloading false 或 --offloading 0 来禁用,如果 GPU 内存允许,禁用后速度会更快) |

--group_offloading |

bool | 否 | None |

启用组卸载(默认:None,如果启用了 offloading 则自动启用。使用 --group_offloading 或 --group_offloading true/1 来启用,--group_offloading false/0 来禁用) |

--overlap_group_offloading |

bool | 否 | true |

启用重叠组卸载(默认:true)。会显著增加 CPU 内存占用,但能够提速。使用 --overlap_group_offloading 或 --overlap_group_offloading true/1 来启用,--overlap_group_offloading false/0 来禁用 |

--dtype |

str | 否 | bf16 |

Transformer 的数据类型:bf16(更快,内存占用更低)或 fp32(质量更好,速度更慢,内存占用更高) |

--use_sageattn |

bool | 否 | false |

启用 SageAttention(使用 --use_sageattn 或 --use_sageattn true/1 来启用,--use_sageattn false/0 来禁用) |

--sage_blocks_range |

str | 否 | 0-53 |

SageAttention 块范围(例如:0-5 或 0,1,2,3,4,5) |

--enable_torch_compile |

bool | 否 | false |

启用 torch compile 以优化 transformer(使用 --enable_torch_compile 或 --enable_torch_compile true/1 来启用,--enable_torch_compile false/0 来禁用) |

--enable_cache |

bool | 否 | false |

启用 transformer 缓存(使用 --enable_cache 或 --enable_cache true/1 来启用,--enable_cache false/0 来禁用) |

--cache_start_step |

int | 否 | 11 |

使用缓存时跳过的起始步数 |

--cache_end_step |

int | 否 | 45 |

使用缓存时跳过的结束步数 |

--total_steps |

int | 否 | 50 |

总推理步数 |

--cache_step_interval |

int | 否 | 4 |

使用缓存时跳过的步数间隔 |

注意: 使用 --nproc_per_node 指定使用的 GPU 数量。例如,--nproc_per_node=8 表示使用 8 个 GPU。

最优推理配置

下表提供了每个模型的最优推理配置(CFG 缩放、嵌入 CFG 缩放、流偏移和推理步数),以获得最佳生成质量:

| 模型 | CFG 缩放 | 嵌入 CFG 缩放 | 流偏移 | 推理步数 |

|---|---|---|---|---|

| 480p T2V | 6 | None | 5 | 50 |

| 480p I2V | 6 | None | 5 | 50 |

| 720p T2V | 6 | None | 9 | 50 |

| 720p I2V | 6 | None | 7 | 50 |

| 480p T2V cfg 蒸馏 | 1 | None | 5 | 50 |

| 480p I2V cfg 蒸馏 | 1 | None | 5 | 50 |

| 720p T2V cfg 蒸馏 | 1 | None | 9 | 50 |

| 720p I2V cfg 蒸馏 | 1 | None | 7 | 50 |

| 720p T2V cfg 蒸馏稀疏 | 1 | None | 9 | 50 |

| 720p I2V cfg 蒸馏稀疏 | 1 | None | 7 | 50 |

| 480→720 超分 步数蒸馏 | 1 | None | 2 | 6 |

| 720→1080 超分 步数蒸馏 | 1 | None | 2 | 8 |

请注意我们提供的cfg蒸馏模型,需要50步的推理步数来获得正确的结果.

🧱 模型卡片

| 模型名称 | 下载链接 |

|---|---|

| HunyuanVideo-1.5-480P-T2V | 480P-T2V |

| HunyuanVideo-1.5-480P-I2V | 480P-I2V |

| HunyuanVideo-1.5-480P-T2V-cfg-distill | 480P-T2V-cfg-distill |

| HunyuanVideo-1.5-480P-I2V-cfg-distill | 480P-I2V-cfg-distill |

| HunyuanVideo-1.5-720P-T2V | 720P-T2V |

| HunyuanVideo-1.5-720P-I2V | 720P-I2V |

| HunyuanVideo-1.5-720P-T2V-cfg-distill | Comming soon |

| HunyuanVideo-1.5-720P-I2V-cfg-distill | 720P-I2V-cfg-distill |

| HunyuanVideo-1.5-720P-T2V-sparse-cfg-distill | Comming soon |

| HunyuanVideo-1.5-720P-I2V-sparse-cfg-distill | 720P-I2V-sparse-cfg-distill |

| HunyuanVideo-1.5-720P-sr-step-distill | 720P-sr |

| HunyuanVideo-1.5-1080P-sr-step-distill | 1080P-sr |

🎬 更多示例

📊 性能评估

评分

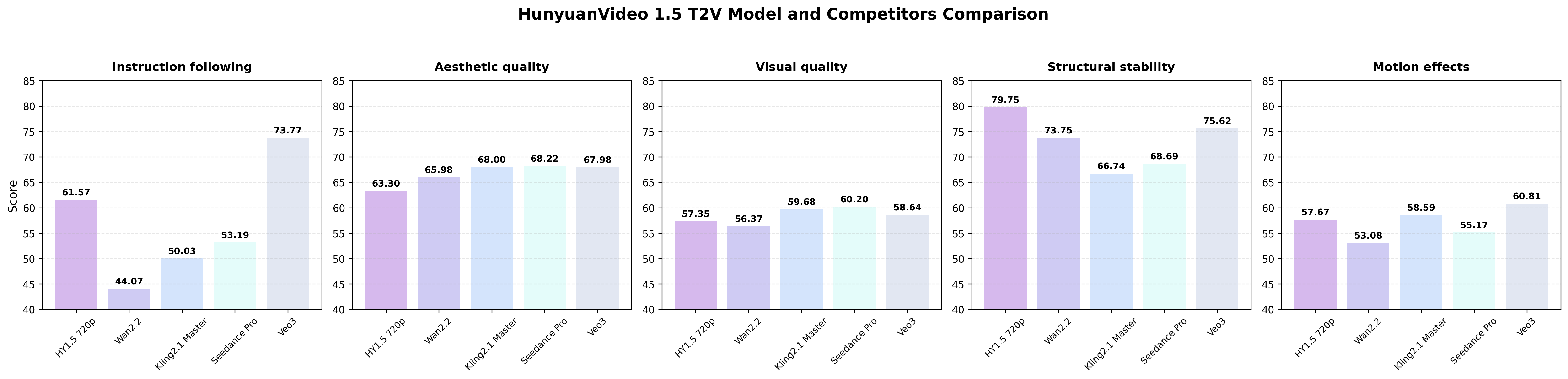

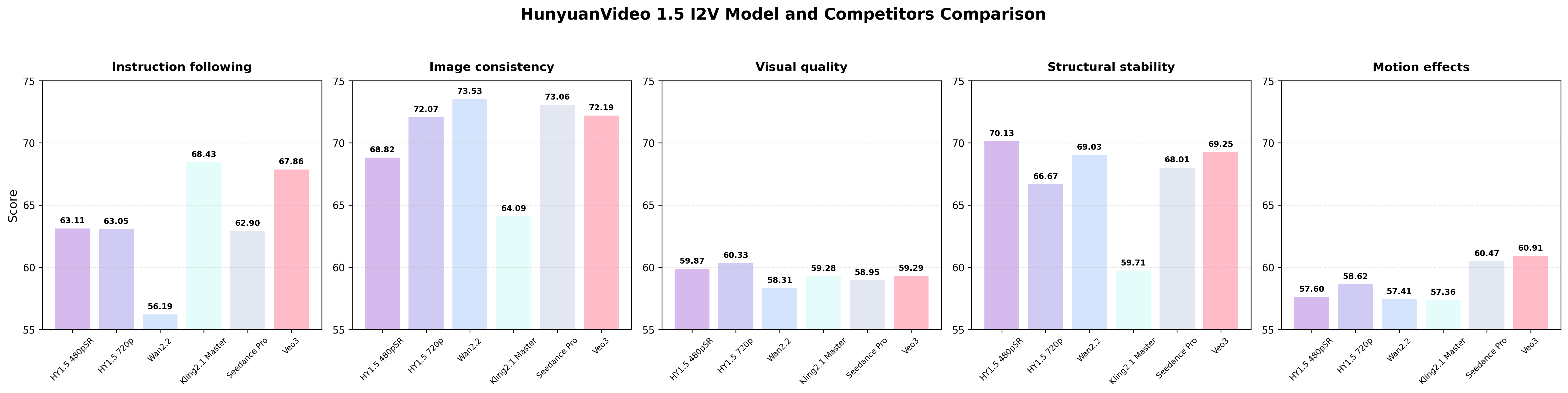

我们使用全面的评分方法来评估文生视频生成,考虑了五个关键维度:文本-视频一致性、视觉质量、结构稳定性、运动效果以及单帧的美学质量。对于图生视频生成,评估包括图像-视频一致性、指令响应性、视觉质量、结构稳定性和运动效果。

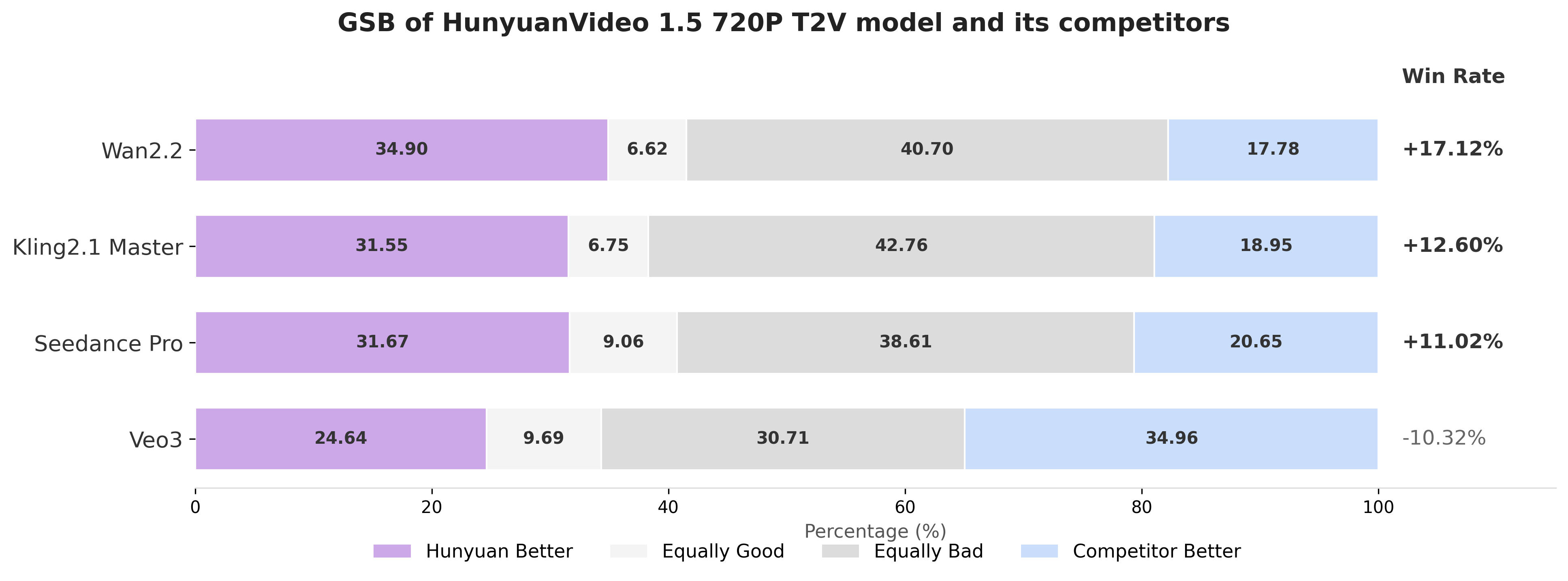

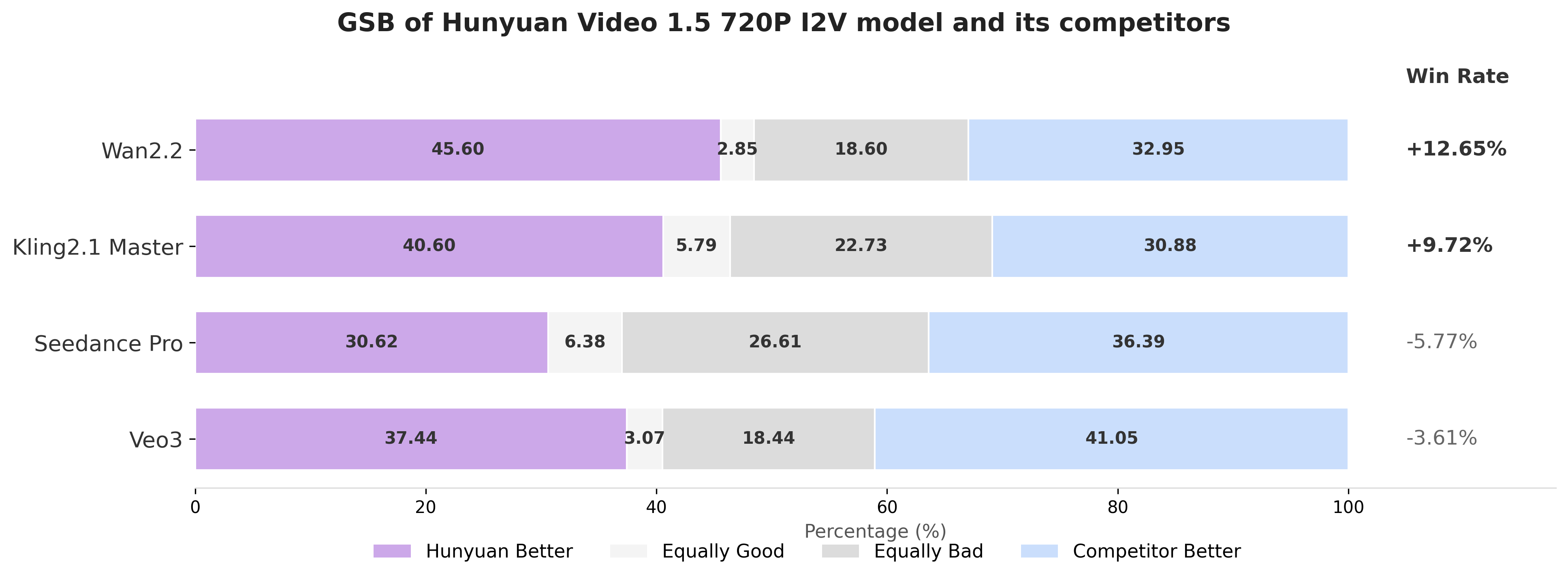

GSB

GSB(Good/Same/Bad)评估法被广泛用于基于整体视频感知质量来评估两个模型的相对性能。我们精心构建了300个多样化文本提示词和300个图像样本,以覆盖文本生成视频和图像生成视频任务的平衡应用场景。针对每个提示词或图像输入,各模型均在单次运行中生成同等数量的视频样本以确保可比性。为保持公平性,每个输入仅执行一次推理且不进行任何结果筛选。所有参与对比的模型均采用其默认配置进行评估,并由百余名专业评估员完成评测过程。

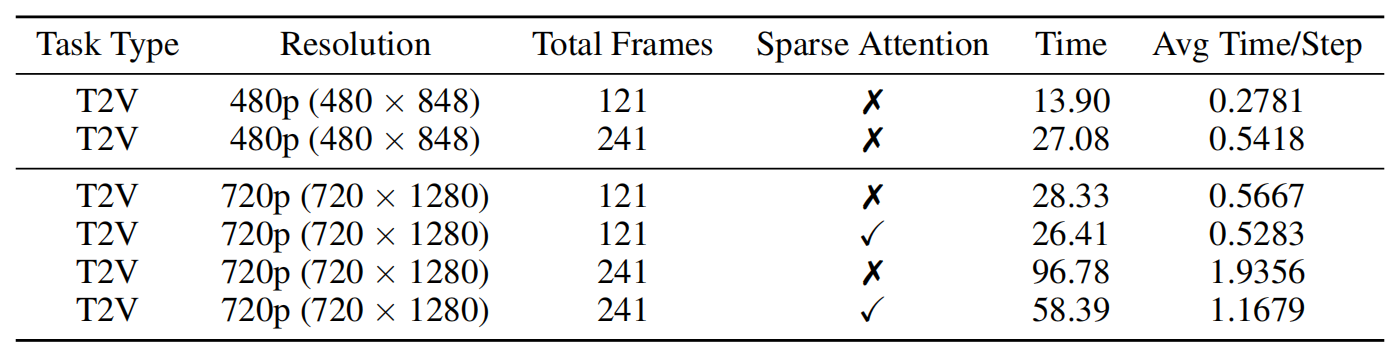

推理速度

我们在8块H800 GPU上启用了基础工程级加速技术,报告推理速度,以展示在实际部署场景中可实现的实用性能。 请注意,在本实验中,我们不以牺牲生成质量为代价追求最极端的加速,而是在保持几乎相同的输出质量的同时实现显著的速度提升。

我们在下方报告了HunyuanVideo-1.5在50个扩散步数下的总推理时间:

📚 引用

@misc{hunyuanvideo2025,

title={HunyuanVideo 1.5 Technical Report},

author={Tencent Hunyuan Foundation Model Team},

year={2025},

eprint={2511.18870},

archivePrefix={arXiv},

primaryClass={cs.CV},

url={https://arxiv.org/abs/2511.18870},

}

🙏 致谢

我们要感谢 Transformers, Diffusers , HuggingFace 以及 Qwen-VL的贡献者,感谢他们的公开研究和探索。